Facebook tiene un departamento que monitorea publicaciones con discursos de odio, violencia e imágenes inapropiadas.

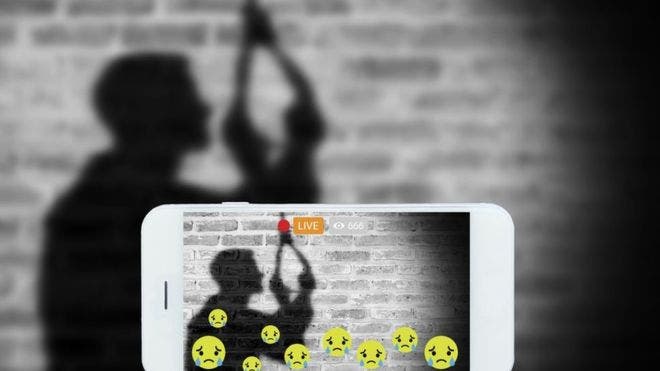

Un grupo de amigos prende fuego a un perro de la calle; unos adolescentes son obligados a tener sexo oral; una niña con una cuchilla de afeitar anuncia su suicidio en un video en vivo; un recién nacido es golpeado por un pariente en la cuna…

La lista es interminable. Todo lo peor que puede haber en Facebook durante ocho horas, de lunes a viernes, a cambio de un salario mínimo.

Sergio, un joven brasileño que pidió no ser identificado, vivió esta rutina durante casi un año, hasta que abandonó su empleo como revisor de denuncias sobre violencia y odio en la página en portugués de la red social.

Desde entonces, dice, se ha convertido en una persona más «fría e insensible» en la vida fuera de internet.

«Veía vídeos en directo por si alguien iba a matarse», explica.

Su función era decidir lo más rápido posible si las publicaciones agresivas que otros usuarios denunciaban eran tolerables o pasaban de los límites establecidos por Facebook.

En su oficina, la meta para cada revisor era evaluar 3.500 fotos, videos y textos denunciados al día. Más de siete por minuto o uno cada 8,5 segundos.

«Imposible no tener error humano en ese ritmo», dice Sergio, que hoy trabaja como freelancer y decidió apagar sus rastros en la red social después de conocerla «por dentro».

Rutina

Según Sergio, el empleo de los que trabajan de esta forma para el imperio de Mark Zuckerberg nada tiene que ver con la imagen común que tenemos de las oficinas de Silicon Valley.

En un edificio con largas filas de ordenadores distribuidos en varios pisos, Sergio y aproximadamente 500 colegas de todo el mundo pasaban días evaluando denuncias sobre pedofilia, desnudos, necrofilia, suicidios, asesinatos, asedios, amenazas, armas, drogas y violencia animal en más de 10 idiomas.

Según el extrabajador, en estos centros de revisión de la red social más utilizada del planeta, los teléfonos móviles están prohibidos, las pausas para la comida o el baño son monitoreadas y los contratos de trabajo prevén multas y procesos judiciales contra la fuga de información.

«Era como una central de atención telefónica, sin los teléfonos. La gente estaba allí para atender al cliente: en este caso, Facebook y todos sus usuarios», dice.

En su computadora, Sergio tenía acceso a una línea de tiempo «alternativa» que mostraba solo las entradas objetivo de denuncias de los usuarios, al azar, junto a un menú sobre posibles violaciones.

Los moderadores solo visualizan el nombre del autor de las publicaciones y no tienen acceso a sus perfiles completos. Su misión es eliminar, ignorar o enviar la publicación a una evaluación superior, lo que ocurre especialmente en casos de suicidio o pedofilia, que a su vez son enviados a las autoridades.

Los moderadores

Los revisores de contenido, según Sergio, son normalmente jóvenes profesionales que viven en el extranjero o que no encuentran trabajo en sus áreas. La mayoría no completa un año en el puesto.

La presión para cumplir las metas aparecía, según Sergio, en reuniones recurrentes con supervisores.

«Tenían informes periódicos sobre metas de moderación. Los jefes a veces parecían porristas e intentaban motivarnos diciendo que habíamos salvado a X personas de suicidios o agresiones en el mes «, cuenta.

«Pero también decían siempre que la continuidad de nuestros empleos dependía del cumplimiento de las metas diarias y citaba otros lugares con resultados mejores que el nuestro, la gente nunca sabía cuánto tiempo duraría la oficina», agrega.

Hace una semana, al anunciar un aumento del 47% en la facturación anual de Facebook, que superó por primera vez en la historia la marca de US$10.000 millones de dólares en un trimestre, Mark Zuckerberg prometió invertir en «personas y tecnología para identificar mal comportamiento y eliminar noticias falsas, discurso de odio y otros contenidos problemáticos » de la red.

En mayo, la jefa de Política Global de Facebook, Monika Bickert, comentó el trabajo de revisores como Sergio en un texto sobre los desafíos de la moderación de contenidos.

«Ellos tienen un obstáculo: entender el contexto, es difícil juzgar la intención detrás de una entrada, o el riesgo implícito en otra. Alguien publica un video violento de un ataque terrorista, que inspirará a las personas a imitar la violencia, o a hablar «¿Alguien escribe una broma sobre el suicidio, es un mero comentario o un grito de ayuda?»

El brasileño confirma las dificultades, pero dice que no conseguía discutir decisiones con superiores. «No tenía espacio para pensar críticamente, el trabajo tenía que ser automático y acelerado, era seguir el manual, apretar botón y no hacer muchas preguntas», dice.

Tras una solicitud de la BBC antes de la publicación de esta historia, Facebook respondió que había decidido «no comentar» las declaraciones del extrabajador.

En las preguntas enviadas, se le solicitaba información sobre la carga horaria, metas, y contratos de empleados subcontratados y datos sobre algún eventual apoyo psicológico a trabajadores expuestos a publicaciones violentas.

Lesiones de muerte

Los datos más recientes de Facebook apuntan que la red excluye casi 300.000 publicaciones al mes.

«Ver contenidos fuertes todos los días te hace perder la sensibilidad para ciertas cosas. Especialmente en relación a los desnudos -eran tantas selfies de gente desnuda, primeros planos de penes, vaginas y pezones, que la pornografía perdió la gracia para mí», afirma.

Como no hay consenso en las leyes de diferentes países sobre contenidos ofensivos o discursos de odio en línea (frases que pueden llevar a la prisión en lugares como Alemania pueden ser protegidas como libertad de expresión por la Constitución de EE.UU.), Facebook creó sus propias reglas, considerando raza y etnia, religión, género y orientación sexual como «categorías protegidas».

Los revisores son orientados, siguiendo las normas de la red, para eliminar «cualquier ataque directo a personas» sobre la base de estas categorías.

En cuanto a la violencia, la red determina que las imágenes de interés público, «como abusos de derechos humanos o actos de terrorismo», se mantengan cuando las posturas expresan reprobación o concientización.

En casos de compartir «por el placer sádico de celebrar o enaltecer la violencia», deben ser borradas. Muchos casos generaban discordia entre los empleados.

Choque

Sergio cuenta que lo que más chocaba a sus colegas era la crueldad de las publicaciones con agresiones a animales.

«En una de ellos aparecía una máquina de matadero, con una cuerda que giraba atada a un motor y que tenía a una vaca amarrada, la cuerda la tiraba y la vaca era despedazada viva», dice.

La exposición excesiva a imágenes violentas ya ha llevado a los moderadores de Facebook a desarrollar desórdenes de ansiedad, problemas sexuales y pánico, según varios medios.

El brasileño, sin embargo, dice que era afectado en menor grado por el contenido de las imágenes.

«Primero, porque nací en Brasil, y nuestras referencias de violencia tienden a ser más agresivas que las de colegas europeos, por ejemplo», afirma.

«También porque veía todos los días videos de brutalidad contra niños, minorías y animales y uno termina acostumbrándose a estas imágenes. Para mí, la crueldad humana en términos de palabras, apoyando agresiones, predicando odio, riéndose de las víctimas en comentarios era siempre mucho peor «.

Los traumas llevaron a Sergio a cerrar definitivamente su perfil en Facebook.

«Para no quedar atrapado en las burbujas, en las cámaras de eco donde la gente sólo oye las propias voces y las de quienes concuerdan con ellas, decidí aislarme», cuenta el brasileño.

«Yo no quería convertirme en una de esas personas que aparecían en las denuncias».