La inteligencia artificial (IA) se está utilizando para realizar llamadas en las que se imitan las voces de personas conocidas para estafar al destinatario.

Estas llamadas utilizan lo que se conoce como IA generativa, es decir, sistemas capaces de crear texto, imágenes o cualquier otro soporte, como vídeo, a partir de las instrucciones de un usuario.

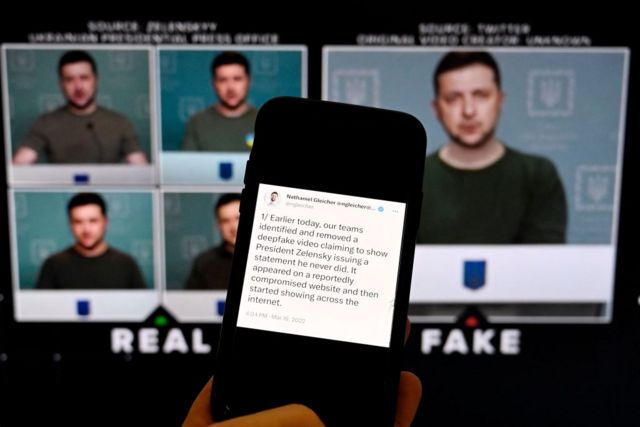

Los deepfakes (falsificaciones profundas) han ganado notoriedad en los últimos años con una serie de incidentes de gran repercusión, tales como el uso de la imagen de la actriz británica Emma Watson en una serie de anuncios sugerentes que aparecieron en Facebook e Instagram.

También está el video de 2022 ampliamente compartido y desmentido, en el que el presidente ucraniano Volodymyr Zelensky parecía decirles a los ucranianos que "depusieran las armas".

Ahora, la tecnología para crear un audio falso, una copia realista de la voz de una persona, se está volviendo cada vez más común.

Dando armas al enemigo

Para crear una copia realista de la voz de alguien se necesitan datos para entrenar al algoritmo. Esto significa tener muchas grabaciones de audio de la voz de la persona.

Cuantos más ejemplos de la voz de la persona se puedan introducir en los algoritmos, mejor y más convincente será la copia final.

Muchos de nosotros ya compartimos detalles de nuestras vidas cotidianas en internet. Esto significa que los datos de audio necesarios para crear una copia realista de una voz podrían estar fácilmente disponibles en las redes sociales.

Pero, ¿qué ocurre una vez que la copia está ahí fuera? ¿Qué es lo peor que puede ocurrir? Un algoritmo de deepfake podría permitir a cualquiera que posea los datos hacer que "tú" digas lo que quieran.

En la práctica, esto puede ser tan sencillo como escribir un texto y hacer que la computador lo diga en voz alta como si fueras tu voz.

Los principales retos

Esta posibilidad puede aumentar el riesgo de aumentar la prevalencia de la desinformación. Puede utilizarse para tratar de influir en la opinión pública internacional o nacional, como se ha visto con los "videos" de Zelensky.

Pero la ubicuidad y disponibilidad de estas tecnologías también plantea retos importantes a nivel local, sobre todo en la creciente tendencia de las "llamadas con IA para estafar".

Muchas personas habrán recibido una llamada de estafa o phishing que nos dice, por ejemplo, que nuestro computadora se ha visto comprometida y que debemos iniciar sesión inmediatamente, lo que podría dar al autor de la llamada acceso a nuestros datos.

A menudo es muy fácil detectar los engaños, especialmente cuando la persona que hace la llamada formula preguntas y pide información que alguien de una organización legítima no haría.

Sin embargo, ahora imagine que la voz al otro lado del teléfono no es un extraño, sino que suena exactamente como un amigo o un ser querido. Esto inyecta un nivel completamente nuevo de complejidad y de pánico para el desafortunado destinatario.

Una historia reciente reportada por la cadena CNN destaca un incidente en el que una madre recibió una llamada de un número desconocido. Cuando contestó el teléfono, era su hija. La hija supuestamente había sido secuestrada y estaba llamando a su madre para pedirle un rescate.

De hecho, la niña estaba sana y salva. Los estafadores habían hecho una falsificación de su voz.

Este no es un incidente aislado, y la estafa se ha dado con con variaciones, que incluyen un supuesto accidente automovilístico, en el que la presunta víctima llama a su familia para pedir dinero para superar el accidente.

Viejo truco con nueva tecnología

No se trata de una estafa nueva en sí misma. El término "estafa del secuestro virtual" existe desde hace varios años. Y puede adoptar muchas formas, pero una de las más comunes consiste en engañar a las víctimas para que paguen un rescate para liberar a un ser querido que creen amenazado.

El estafador intenta establecer una demanda incondicional y lograr que la víctima pague el rescate rápido antes de que descubra que fue engañada.

Sin embargo, el surgimiento de tecnologías de IA poderosas y disponibles ha subido la apuesta significativamente y ha hecho que las cosas sean más personales.

Una cosa es colgar a una llamada anónima, pero se necesita mucha confianza para colgarle a alguien que suena como un hijo o pareja.

Existe un software que se puede usar para identificar las falsificaciones y que crea una representación visual del audio llamada espectrograma. Cuando está escuchando la llamada, puede parecer imposible distinguirla de la persona real, pero las voces se pueden diferenciar cuando los espectrogramas se analizan uno al lado del otro.

Al menos un grupo ha ofrecido un software de detección que se puede descargar, aunque es posible que dichas soluciones aún requieran algunos conocimientos técnicos para su uso.

La mayoría de las personas no podrán generar espectrogramas, entonces, ¿qué se puede hacer cuando no se está seguro de que lo que estás escuchando es real? Al igual que con cualquier otro medio de comunicación, hay que ser escéptico.

Si recibes una llamada inesperada de un ser querido pidiéndote dinero o haciéndote solicitudes que parecen fuera de lugar, devuélvele la llamada o envíale un mensaje de texto para confirmar que realmente estás hablando con él.

A medida que se expanden las capacidades de la IA, las líneas entre la realidad y la ficción se difuminan más. Y no es probable que podamos frenar esa tecnología. Esto significa que la gente tendrá que volverse más cautelosa.

*Oliver Buckley es profesor asociado de Ciberseguridad de la Universidad de East Anglia (Reino Unido) y es egresado en Computación y Ciencias de la Computación de las universidades de Liverpool y de Galés.