La controvertida tecnología que permite crear identidades falsas

Ya tuvimos que abrir los ojos a las noticias falsas. Pero, ¿en qué momento tendremos que dejar de confiar también en los videos y archivos sonoros que, gracias a la inteligencia artificial, presentan identidades falsas de manera casi perfecta?

Cada vez son más los avances tecnológicos que permiten hacer que una persona "haga" o "diga" lo que sea.

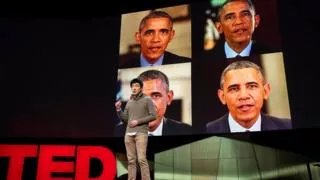

Un video que mostraba —o parecía mostrar— al expresidente de Estados Unidos Barack Obama hablando sobre un personaje de la exitosa película "Black Panther" y haciendo un crudo comentario sobre Donald Trump fue uno de los primeros en generar controversia sobre esta cuestión.

Por supuesto, no era el auténtico Obama: la voz del actor Jordan Peele había sido magistralmente sincronizada con los labios del exmandatario.

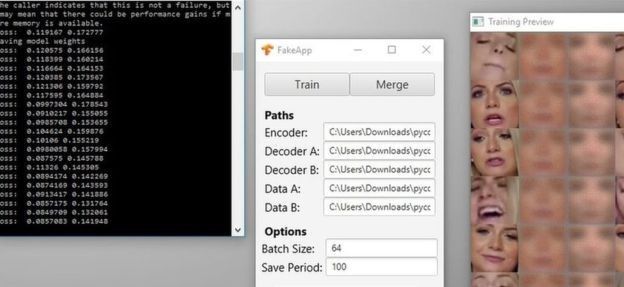

El video en cuestión fue creado por la empresa de comunicación estadounidense Buzzfeed usando una aplicación llamada FakeApp.

Se trata de una herramienta gratuita que también se usó para superponer los rostros de celebridades en videos pornográficos.

Estos fotomontajes son posibles gracias a una tecnología que usa inteligencia artificial para posibilitar el intercambio de caras, y que se hizo popular hace un par de años gracias a aplicaciones como Snapchat. Es lo que en inglés se conoce como "deepfake".

En el caso del "falso Obama", el video fue creado para hacer reflexionar a la gente sobre la amenaza que plantean este tipo de técnicas.

Derechos de autor de la imagenFAKEAPP

Derechos de autor de la imagenFAKEAPPCopias digitales

La científica computacional Dame Wendy Hall es una de las autoras de un informe especial del gobierno británico sobre esta cuestión.

"Lo que está ocurriendo realmente con la inteligencia artificial es el desarrollo de nuevas técnicas, algoritmos de aprendizaje profundo capaces de aprender de datos y, en este caso, datos de videos", le contó a la BBC.

Según la especialista, eso es algo "bastante preocupante".

Hay varias empresas trabajando en el desarrollo de este nuevo tipo de tecnología. Una de ellas es la startup canadiense Lyrebird, que afirma que puede crear una copia digital de la voz de una persona usando simplemente una muestra de un minuto.

Yo mismo traté de usar la demostración que tienen disponible en su sitio web, y aunque no logró producir una versión particularmente contundente de mi propia voz, la firma insiste en que con muchos más datos y su última tecnología puede hacer algo mucho mejor.

Derechos de autor de la imagenGETTY IMAGES

Derechos de autor de la imagenGETTY IMAGESCuando hablé con uno de sus fundadores, Jose Sotelo, me explicó el uso potencial de esta tecnología para lograr que personas con condiciones como la enfermedad de la neurona motora (ENM) —un trastorno progresivo e incurable— puedan tener una voz digital realista una vez que les resulte imposible hablar.

También dijo que es consciente de que podría usarse para engaños y falsificaciones, aunque aseguró que están tomando medidas para evitar que eso suceda.

Pero la tecnología avanza rápidamente.

¿Ver para creer?

Un informe reciente del Instituto para el Futuro de la Humanidad (FHI, por sus siglas en inglés) —en colaboración con varias instituciones, como la Universidad de Oxford, en Reino Unido, o el Centro para una Nueva Seguridad Estadounidense (CNAS)— sobre los posibles usos maliciosos de la inteligencia artificial destacó la elaboración de identidades falsas como una de las principales preocupaciones.

"Es una de las muchas señales que indican que la gente debería ser cautelosa sobre lo que cree y si cree lo que lee y lo que ve", dijo Miles Brundage, uno de los autores del documento.

"Es un desafío hacia la idea de 'ver para creer', sobre todo dentro del contexto de quienes quieren sembrar confusión y generar controversia".

Más escépticos

Fue otra demostración en video, de nuevo con Obama como protagonista, reactivó todo este debate el año pasado. Investigadores de la Universidad de Washington, EE.UU., probaron otras técnicas de aprendizaje automático para hacer coincidir movimientos labiales.

Uno de los académicos detrás del proyecto, Supasorn Suwajanakorn, sostiene que las probabilidades de que esta tecnología se use para fines maliciosos son mínimas.

"¿Qué sentido tiene llegar hasta el final para crear videos falsos y usarlos en noticias falsas si puedes, simplemente, inventarte un texto?", pregunta. "Un video contiene 10.000 fotogramas y puedes detectar uno que se vea mal y entonces asegurar con certeza que el video es falso".

Uno podría pensar que esas mismas técnicas de inteligencia artificial también podían usarse para detener las falsificaciones.

Sin embargo, Dame Wendy no se muestra muy optimista: "Es mucho más difícil crear la tecnología para detectar eso que desarrollar la tecnología para hacer posibles las falsificaciones. No creo que haya soluciones puramente técnicas para esto".

Ella cree que la solución reside en que todos nosotros seamos más escépticos sobre las fuentes que usamos para informarnos en internet.

Derechos de autor de la imagenGETTY IMAGES

Derechos de autor de la imagenGETTY IMAGESLo que está claro es que nuevas armas de propaganda están emergiendo de los laboratorios de inteligencia artificial, y que necesitaremos estar más atentos sobre lo que es real y lo que es falso.